최근 AWS에서 Bedrock이라는 Serverless generative AI 솔루션을 출시했습니다. 이를 통해 개발자들은 AI21 Labs, Anthropic, Cohere, Meta 등 다양한 기업의 기반 모델을 활용할 수 있게 되었다고 하죠.

Serverless generative AI는 기업들이 AI 기능을 더 쉽고 효율적으로 구축하고 배포할 수 있게 해주는 기술로, 최근 급속도로 발전하고 있습니다. 최근 주요 클라우드 업체들이 Serverless generative AI 서비스를 확대하고 있는 추세입니다.

이 글에서는 Serverless generative AI에 대한 정의와 중요성, 장·단점을 알아보겠습니다. 또한 AI 워크로드 최적화를 선도하고 있는 NVIDIA의 Serverless generative AI 솔루션에 대해서도 소개하겠습니다.

Serverless generative AI 정의와 중요성

Serverless generative AI는 개발자가 서버 인프라를 직접 관리할 필요 없이 AI 모델을 실행하고 새로운 콘텐츠를 생성할 수 있게 하는 클라우드 기반 서비스입니다. 개발자는 서버 프로비저닝이나 관리에 신경 쓰지 않고, AI 모델 개발과 실행에만 집중할 수 있다는 장점이 있습니다.

즉, 텍스트, 이미지, 음성 등 다양한 형태의 콘텐츠를 생성하는 Generative AI 기능을 구현하면서도, 동시에 서버리스 아키텍처의 장점을 활용할 수 있게 되는 것이죠. 다양한 사전 훈련(Pre-Training) 모델을 API 호출만으로 애플리케이션에 적용할 수 있습니다.

Serverless generative AI를 적극적으로 활용하면 복잡한 AI 기술을 더 많은 개발자와 기업이 활용할 수 있을 뿐만 아니라, 빠른 프로토타이핑과 배포가 가능해져 새로운 AI 애플리케이션 개발 속도가 빨라집니다.

특히 Serverless generative AI는 사용량에 따라 자동으로 리소스를 조정할 수 있다는 장점이 있는데요. 따라서 실제 사용한 컴퓨팅 리소스에 대해서만 비용을 지불하고, 자동으로 리소스를 확장하거나 축소하여 효율적인 리소스 관리가 가능해졌습니다.

Serverless generative AI 장점과 한계

장점

다양한 클라우드 제공업체들이 Serverless generative AI 솔루션을 출시하면서, AI 모델 및 배포가 더욱 간단해지고 있습니다. Cloudflare의 Workers AI를 사용하면, 개발자들은 Hugging Face에서 원클릭으로 AI 모델을 배포할 수 있죠. 즉, GPU나 인프라 설정 없이도 AI 애플리케이션을 빠르고 저렴하게 실험 및 반복이 가능해졌다는 뜻입니다.

또한 Serverless generative AI 솔루션은 사용량 기반 과금으로 리소스를 효율적으로 활용할 수 있을 뿐만 아니라, 복잡한 설정 없이도 신속하게 AI 서비스를 구축하고 배포할 수 있을 것으로 기대됩니다.

예를 들어, Alibaba Cloud에서 발표한 PAI-EAS(Platform for AI-Elastic Algorithm Service)의 서버리스 버전은 개인과 기업에게 비용 효율적인 모델 배포 및 추론 솔루션을 제공하고 있습니다. 역시 사용량 기반 과금이기 때문에, 리소스를 효율적으로 활용할 수 있죠.

또한 Pinecone에서 출시한 서버리스 벡터 데이터베이스 역시 Generative AI 애플리케이션의 정확성과 속도, 확장성을 향상시키면서 운영 비용을 최대 50배까지 절감할 수 있다고 발표했습니다.

한계

다만 Serverless generative AI에도 극복해야 할 문제가 있습니다.

먼저, 대부분의 서버리스 플랫폼은 함수 실행 시간에 제한을 두고 있으며, 메모리 사용량 역시 제한적입니다. 규모가 크고 복잡한 AI 모델일 경우, 모델을 로드하고 실행하는 작업부터 제한 시간 내에 처리를 완료하기 어려울 수 있습니다.

또한 성능 관리에 대한 문제점도 제기되고 있는데요. 서버리스 함수가 처음 호출될 때 발행하는 콜드 스타트 딜레이는 AI 모델의 응답 시간에 영향을 줄 수도 있습니다. 대용량 데이터를 처리해야 하는 AI 모델의 경우네느 서버리스 환경에서 데이터 전송 병목 현상이 발생할 수도 있죠.

마지막으로 Serverless generative AI는 클라우드 제공업체의 기술에 의존하는 방식입니다. 이런 벤더 종속이 추후에는 예측 불가능한 비용 이슈로 이어질 수도 있습니다.

Serverless generative AI 솔루션 비교 (AWS vs. NVIDIA)

AWS와 NVIDIA 모두 Serviceless generative AI 솔루션을 제공하고 있지만, 각각의 접근 방식과 강점이 조금씩 다릅니다. 여기서는 두 기업의 솔루션 특징에 대해 간단히 확인해 보겠습니다.

Amazon Web service

AWS Bedrock는 완전 관리형 서비스로, 다양한 모델에 대한 액세스를 제공합니다. AI21 Labs, Anthropic, Cohere, Metastability AI, Amazon 등 다양한 회사의 모델을 지원하며, 개발자가 인프라 관리 없이 AI 워크로드를 배포하고 확장할 수 있게 합니다.

AWS Lambda는 서버리스 컴퓨팅의 선구자로, 코드 실행에 초점을 맞춘 솔루션입니다. AI 및 머신러닝 워크로드에도 활용할 수 있지만, 주로 일반적인 서버리스 컴퓨팅에 사용하고 있습니다.

특히 Amazon SageMaker는 머신러닝 모델의 구축과 훈련, 배포를 위한 완전 관리형 플랫폼인데요. NVIDIA NIM 추론 마이크로서비스를 적용하여 GPU 기반의 모델이 가격 대비 성능이 훨씬 더 최적화될 수 있도록 구현했죠.

NVIDIA

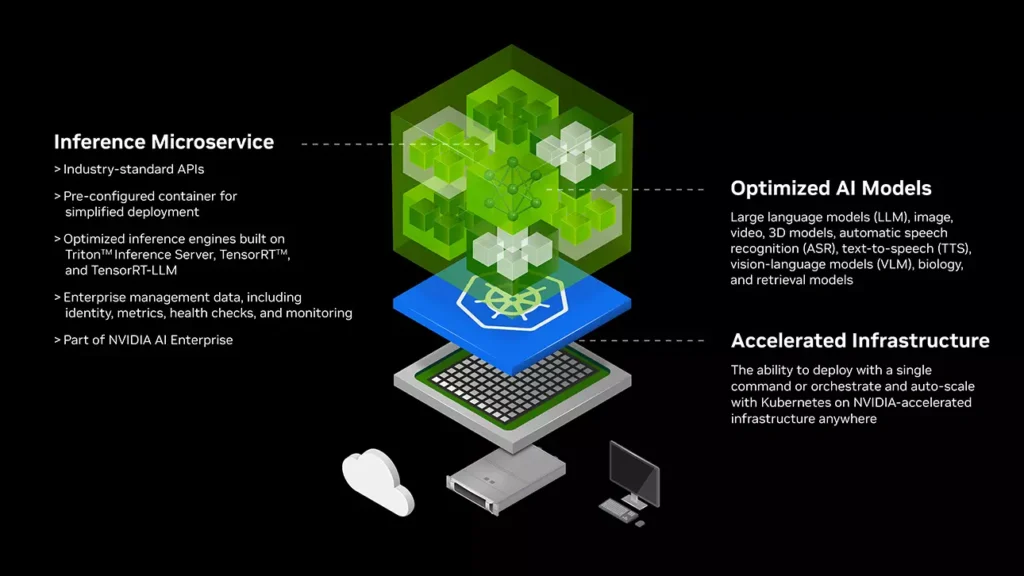

NVIDIA AI Enterprise는 AWS Marketplace를 통해 제공되는 엔터프라이즈급 AI 플랫폼인데요. NIM(NVIDIA Inference Microservices)과 NeMo 마이크로서비스를 포함하여 조직이 생성형 AI와 LLM을 대규모로 활용할 수 있다는 특징이 있습니다.

NVIDIA의 GPU 가속 인스턴스는 AWS EC2 인스턴스에 NVIDIA GPU를 제공하여 복잡한 LLM과 컴퓨팅 집약적인 생성형 AI 애플리케이션의 훈련 및 추론을 가속화할 수 있습니다.

NVIDIA DGX Cloud는 AWS와 공동 엔지니어링한 AI 플랫폼으로, 기업 개발자에게 고급 Generative AI 모델을 구축하고 배포하는 데 필요한 인프라와 소프트웨어를 제공하는 엔드 투 엔드 플랫폼입니다.

비교

AWS는 완전 관리형 서버리스 서비스에 초점을 맞춘 솔루션을 제공합니다. 반면 NVIDIA는 GPU 하드웨어와 소프트웨어 툴을 제공하는 것에 중점을 두고 있으며, 실제로 AWS 인프라 기반으로 실행하는 솔루션입니다.

AWS 솔루션은 AWS 제품 라인에 종속되는 경향이 있습니다. 반면 NVIDIA의 솔루션은 AWS 인프라를 활용하긴 하지만, NVIDIA 고유의 AI 전문성에 중점을 둔 서비스를 제공하고 있습니다.

두 회사 모두 협력 하에 최상의 Serverless generative AI 솔루션을 제공하고 있으며, 각자의 강점을 활용해 시너지를 창출하고 있습니다.

Serverless generative AI 도입 시 중요한 것은?

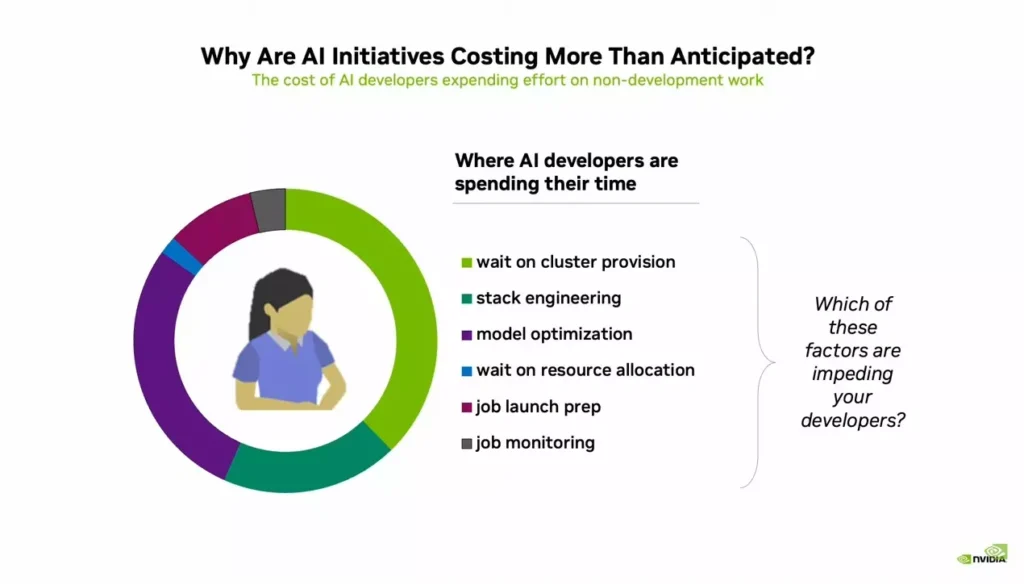

AI 모델의 성능 최적화가 무엇보다 중요해진 시점에서, 기업은 Serverless Generative AI 도입을 적극적으로 고려해볼 필요가 있습니다. 하지만 위에서 언급했던 한계를 정확하게 인지하고 이에 대한 정확한 설계가 필요합니다.

이 문제를 극복하기 위해, NVIDIA는 AI 모델의 구축의 단순화 및 가속화에 최적화된 클라우드 네이티브 마이크로 서비스 세트인 NVIDIA NIM을 도입했습니다. NIM은 애플리케이션에 쉽게 적용할 수 있을 뿐만 아니라 사전 학습된 모델을 제공하기 때문에, 개발 시간을 단축하고 리소스의 효율성을 향상할 수 있습니다.

만약 개발하고 계신 AI에 대한 서비스 고도화가 필요하신 분들은 먼저 아이크래프트의 전문가와 상담해보실 수 있습니다. 이외에도 NVIDIA API 카탈로그를 통해 NVIDIA NIM 마이크로 서비스를 경험하고 프로토타입을 만들 수 있습니다.

또한 엔터프라이즈급 보안과 API 안정성이 필요하신 분들은 NIM에 포함된 NVIDIA AI Enterprise 라이센스를 90일 간 무료로 사용해보실 수도 있습니다.

지금 개발하고 계신 AI의 리소스 효율성이 의심되신다면, 지금 Serverless Generative AI에 대해 더 자세히 알아보세요.

함께 읽으면 좋은 콘텐츠